Depois de alguns problemas de privacidade anteriores, o ChatGPT voltou a partilhar erradamente dados pessoais de alguns utilizadores.

Num novo leak, o chatbot de inteligência artificial voltou a partilhar dados privados, incluindo nomes de utilizadores e passwords.

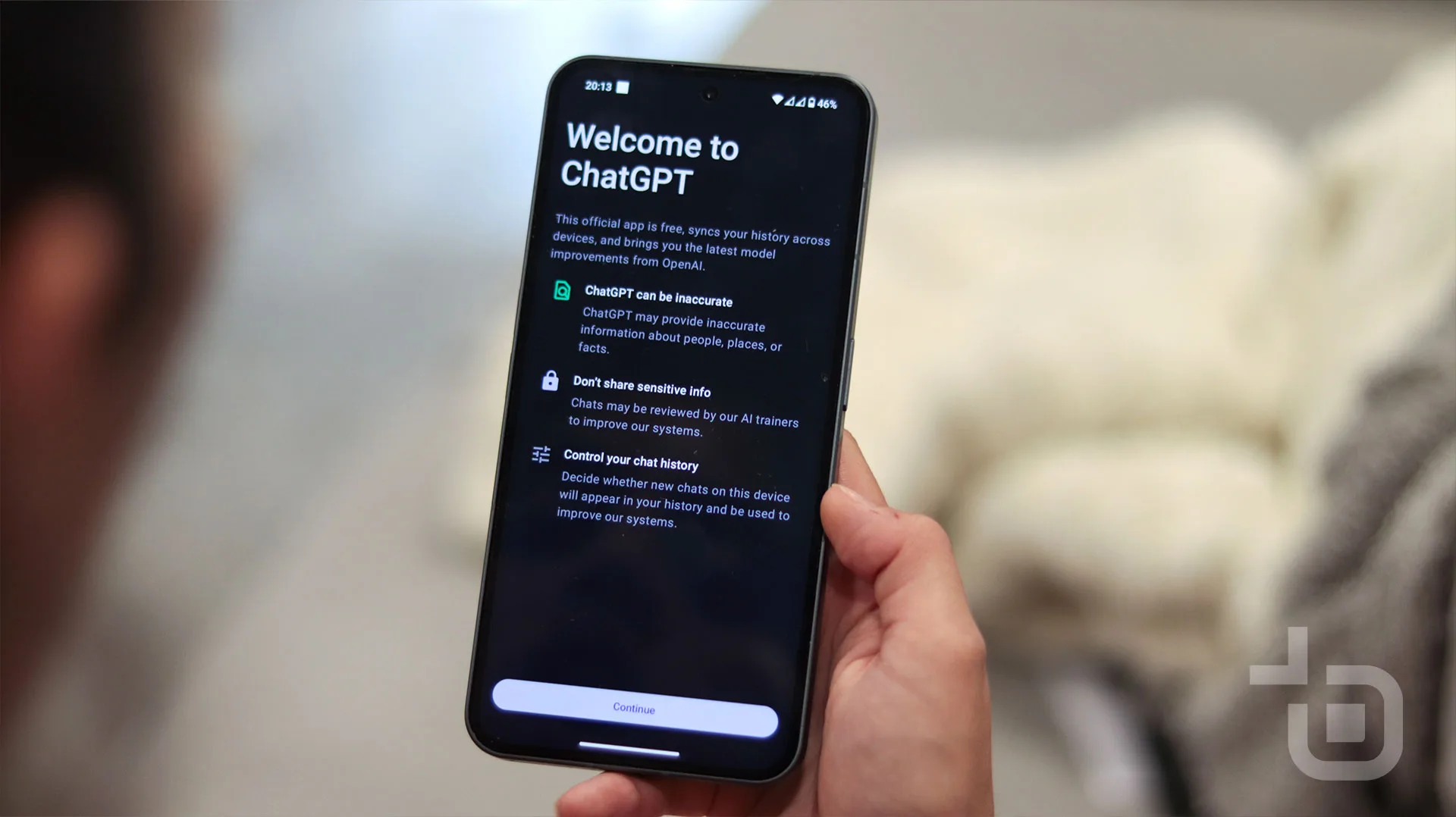

ChatGPT volta a apresentar problemas de privacidade

O ChatGPT é uma ferramenta utilizada atualmente para um grande número de tarefas, desde a realização de uma simples pesquisa de informação, como para ajudar a resolver problemas de programação, cálculos matemáticos e outras tarefas mais exigentes.

Depois de já ter apresentado anteriormente problemas de privacidade, este chatbot voltou a partilhar dados indevidos.

A Arstechnica revelou a captura de ecrã de um utilizador que estava a dialogar com a inteligência artificial e que se apercebeu que tinha alguns separadores no histórico que não lhe pertenciam.

Estes terão sido apresentados pelo ChatGPT como seus e continham várias informações sensíveis. Um deles tinha uma conversa sobre a resolução de problemas com uma plataforma, com dados de acesso incluídos, e outra com um pedido de ajuda para realizar a apresentação de uma investigação ainda não publicada.

A OpenAI já revelou que está a investigar este caso para perceber que bug originou esta partilha incorreta de informação.

Participe no passatempo: